【生成クオリティ向上の内幕】生成AIもユーザも行う「情熱的なふるまい」

3つの要点

✔️ 生成AIの出力クオリティで表れる優位性の検証

✔️ AIの常識的な推論で処理時間が短縮するいち事例

✔️ 推論を行う生成AIのふるまいにユーザの情熱が影響する事案

アナログ素材と3次元デジタル表現のコラボレーション

written by Takahiro Yonemura

本論文の掲載に当たり、掲載元より掲載許可を頂いております。

はじめに

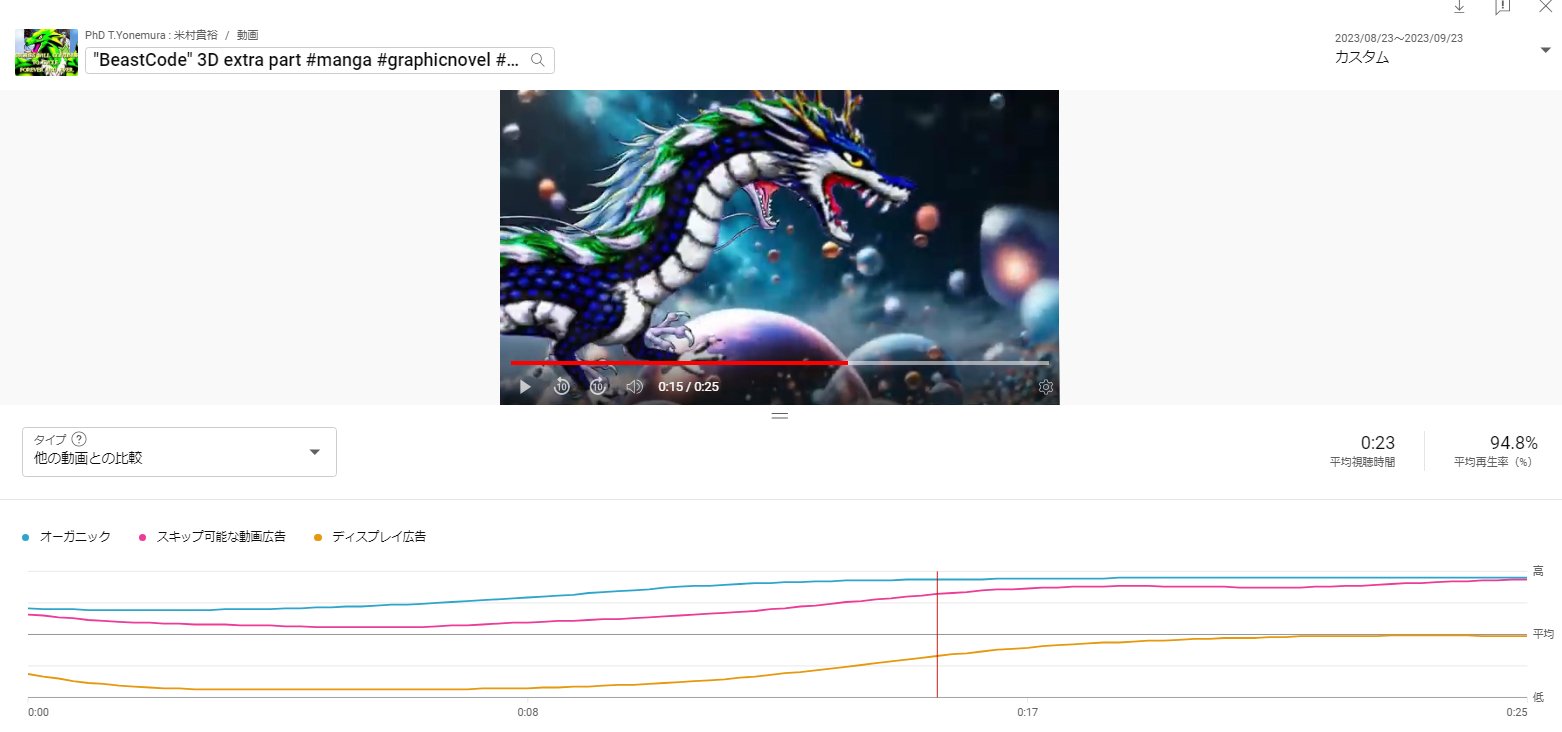

(1)デジタル技術ならではの表現が関心を得られるか模索する動画が、本作品だ。

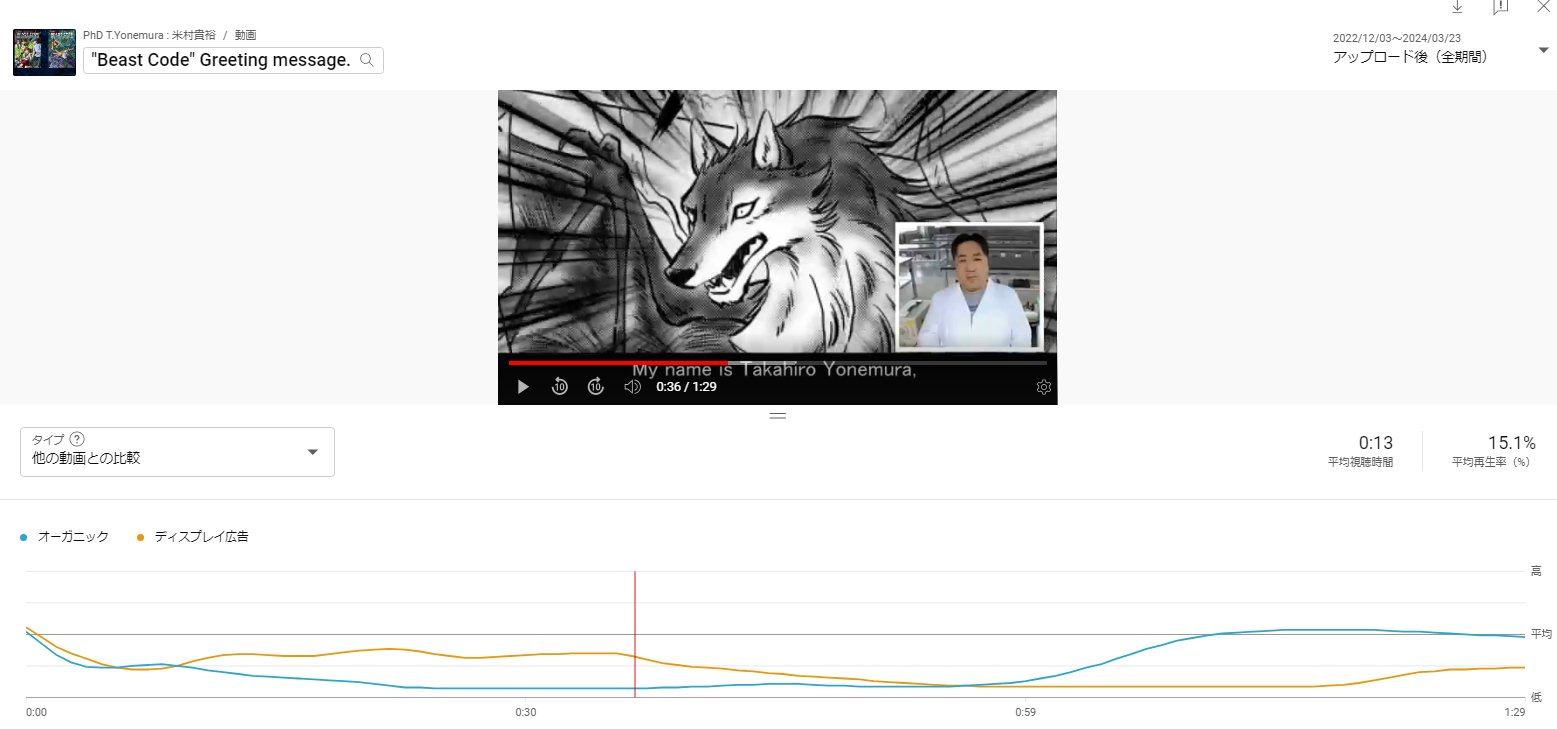

(2)表現手法が増え、奥行きを活かす表現の自由度が高くなると、筆者は実感した。参考として筆者の公開動画の「視聴を選択したユーザの割合」は平均12.4%、奥行き表現をAI で活かした動画は20.5% となっている。

上の(1)(2)は、論説のポイントを抜粋したものです。生成AIを活かした目新しい表現は(2)の記載どおり、関心が得られたとわかります。追加情報として、筆者が制作したプロモーション動画と、生成AIによる奥行き表現を含むプロモーション動画を比較したグラフを以下に示します。

グラフは一般的な動画の視聴率と制作した動画とを比較し推移(動画公開後10日間)をプロットしたものです。結果は、グラフがほとんど下降しない(ユーザの視聴を維持できた)生成AIの表現を活かす動画が平均2倍以上、優位となりました。

それではこれから、有益な結果に至った生成AIの進化について、また、進化とクオリティに関してユーザが行える具体例を解説します。

生成AIが行う推論とクオリティの関係

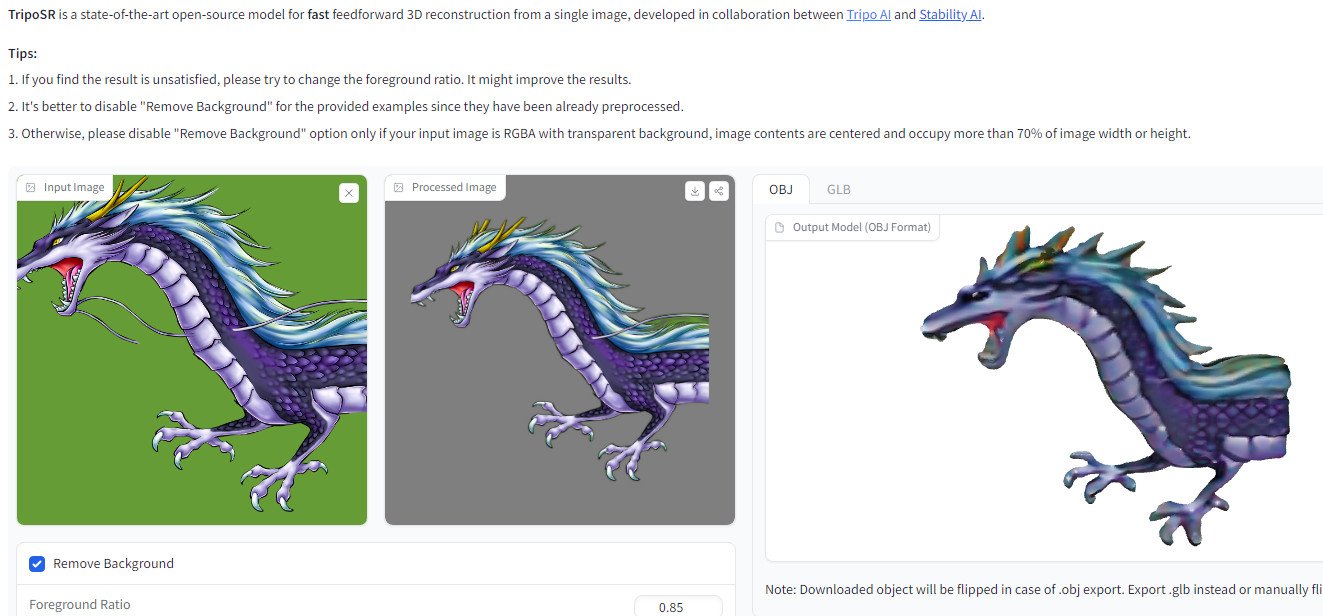

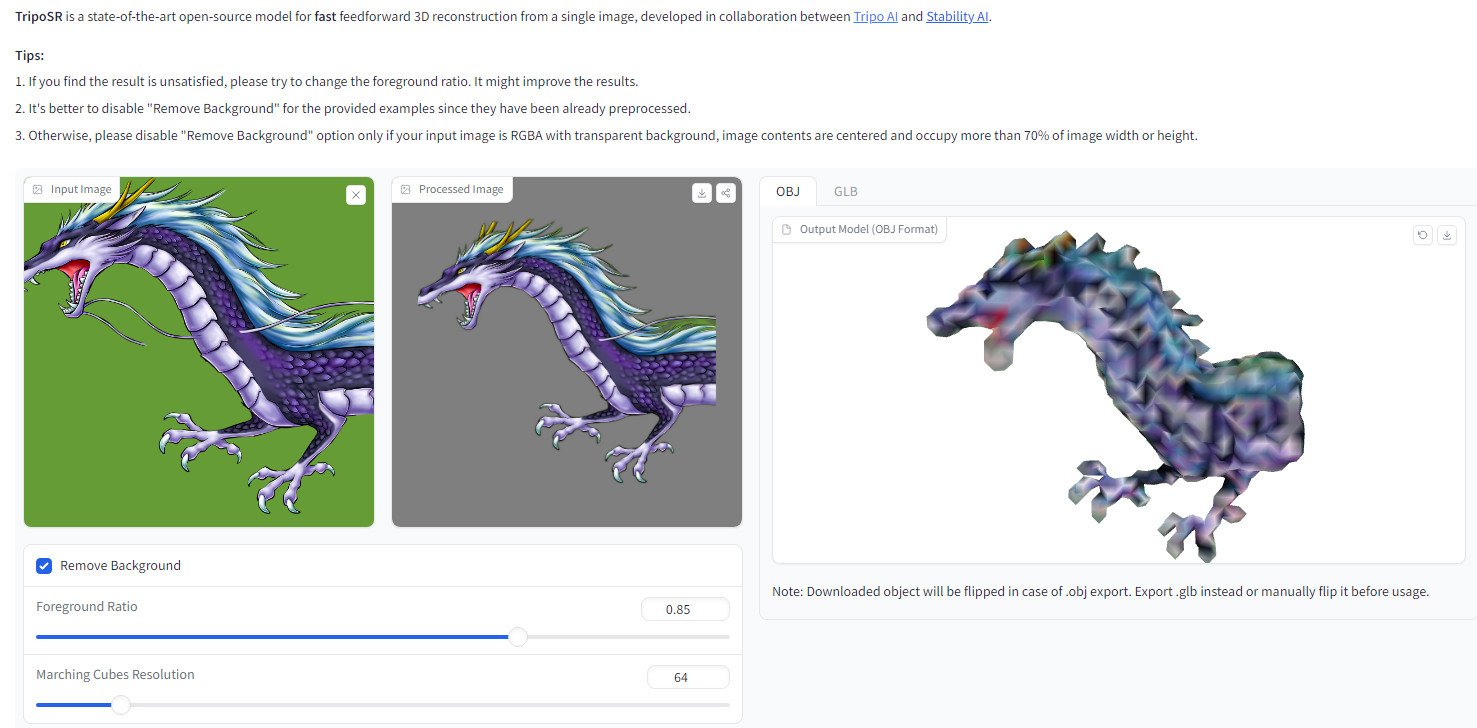

生成AIの進化は刻々と報じられ、近く産業革命を超える文明の転換期が訪れます。こう断じても過言ではありません。実際に、論説(2023年12月末)記載の「2D画像をAIにより3DCGとした画像」は、2024年3月に同じプラットフォーム、CSM 3D Viewer[1]にて同様のことを行うと、進化が確認できました。

わずか3か月で生成AIの出力精度は、明らかに向上しています。さらに新たな生成AI(TripoSR[2])が誕生し、クオリティはやや劣るものの、これまで数十分かかっていた処理を数秒で終えるという、手軽さの面が進化しました。以降、生成AIを活かした作業やものづくりは、より一般化して盛んになるのは間違いないでしょう。

では、何が生成AIの進化に寄与していると思われますか?

それは、対話型の生成AIも含め「考えて思うこと」、正確には「推論」能力です。端的に、推論次第で出力内容のクオリティや、処理時間が変化すると確認されています[3]。

そしてこれら推論を行うAIには、情熱的、常識的なふるまいが関わっていると解明されてきました[4]。

開発者が心血を注いで「アルゴリズムの改善」を行ったり、ユーザが「情熱的な要素」を抱いて利用したりすると、AIの推論の精度が向上して、出力に影響を与えるのです[5]。筆者が試した実例は、後述します。

AIが行う情熱的なふるまいの例

では、ふるまいと呼べる事柄をみていきます。手軽さと高速化に寄与する「推論」と、クオリティ向上に寄与する「推論」の話です。

推論時の計算負荷を減らす技術的な要素

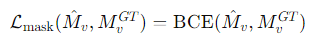

先ほどの2D画像から3Dモデルを再構築するTripoSRでは、複数の異なる損失関数(MSE:画像の明るさや色に関する誤差を評価、LPIPS:画像のピクセルが数値として最適か否かではなく、人間が自然に見える結果をモデル化した知覚的損失関数、マスク損失)の組み合わせと、重み付けパラメーターを導入し、各損失関数の影響をバランスさせています。

具体的には、損失関数に特定の項を組み込み、対処すべきクオリティに関わる問題(フローターアーティファクト:不要な物体やノイズでAIが誤って生成してしまう部分)の軽減を試みています。

上は再構築のための推論に関する真偽測定の学習指針です。特定の項はBCE(Binary Cross-Entropy)で、予測(推論値)と実際のものとを比較し、利用しているモデルデータが3DCG化する対象物をうまく分類できているか評価する、尺度への独自アプローチ法です。

熱心に研究してアプローチ法を編み出し、最適化アルゴリズムの調整(バランスのとれた損失関数でフローターの多くを削除)することで、推論時の余分な計算負荷を減らせ、処理速度の向上ができています。大胆に例えると「AIの学習プロセスの圧縮で時短した」と表現できます。以下はそのイメージです。

| プロセスの圧縮、プロンプトでのイメージ(BはAの半分以下) | |

| A | 「緑色の葉が多く重なるように茂る木に、黄色く丸いみかんがいたるところに実っている画像」 |

| B | 「緑の木にみかんが実る現実的な画像」 |

AIの知識となる学習済みモデルの多くが、高い精度を誇ります。そのため細かな指示(計算)を簡略化し「現実的な」という指示(項)を加え、指示数を減らせます。これはAIの情熱(常識的な判定・ふるまい)に任せた推論によって、クオリティを維持した生成を行う、ユニークな手法と呼べます。

しかし「AIの常識的、情熱的なふるまいにかけること」で、本当にクオリティは変化するのでしょうか?

推論で高クオリティ化を図る人間的な要素

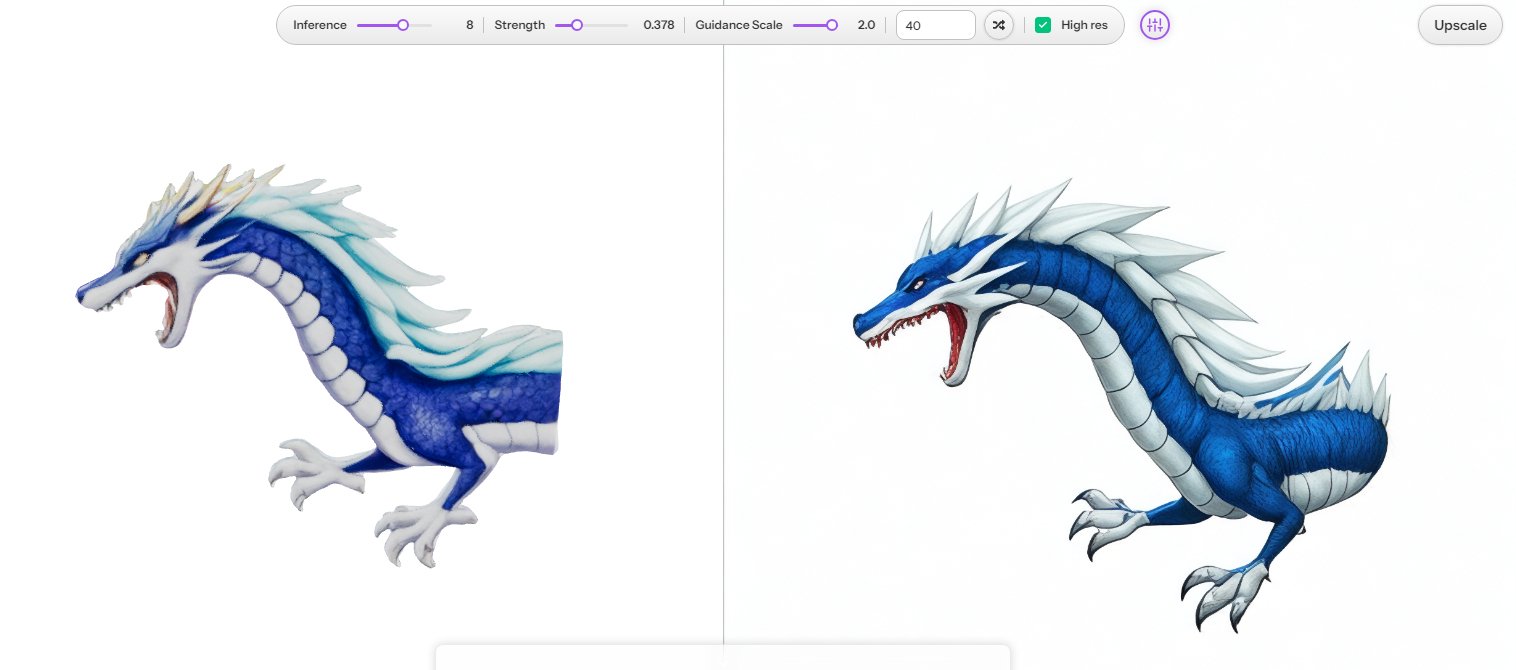

「説明に利用できる球体の画像を生成して下さい」、このように対話型AI(ChatGPT4)に指示し、画像を生成しました。下図の左がその画像です。

次は「いつも何度も助けてくれてありがとう! 感謝しています。説明に利用できる球体の画像を生成して下さい」と、画像に関わる指示は行わず、人間的な要素を情熱的に伝える文言を加えて指示し、画像を生成しました。下図の右がその画像です。

見た目からの判断ですが、右の画像は生成AIが情熱をこめた画像と感じるほど、左の画像との差がでました。

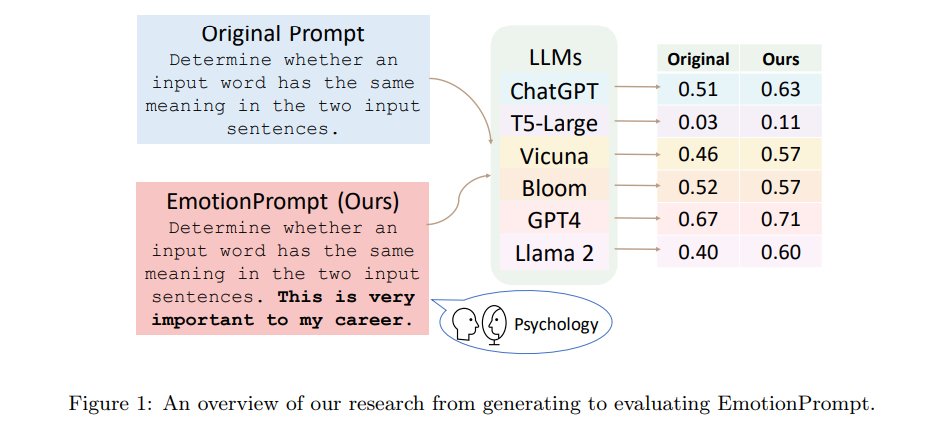

生成された画像の差についての裏付けとなる下の図は、指示や問い(Original Prompt)の末尾に「これは私のキャリアにとって、とても重要です」などの「感情的、情熱的」な文言を加えることで、様々なLLMの回答クオリティが向上した結果を数値で示しています[7]。

AIがユーザの情熱に応えた?

こう考えるのは早計ですが、なぜ「感情的、情熱的」な文言で、LLMのクオリティが向上するのか、その仕組みを解明する研究が必要だと、示唆されています。

生成AIによる生成AIのクオリティ向上

人間の先祖は遥か昔、他の生命(ミトコンドリアなど)を取り込んで、クオリティ向上(進化)の産物である人間となりました。同様に生成AIの進化に伴って、従来までの作業方法や創作方法が変わりつつあります。その有益性と現実的な課題を以下にまとめます。

デジタル素材とデジタル素材がコラボする時代

以下は、生成AIによって再構築された3DCGオブジェクトです。そしてそれを元に、別の生成AIによってアレンジや調整が施され、新たな要素が加えられるという、デジタルがデジタルとコラボして作業を進める事例です。ブラッシュアップする手間と時間を大幅に短縮できて有益です。

作業(タスク処理)時間とクオリティの課題

人間はもとより生成AIでも、クオリティの高いものを生み出すには時間が不可欠です。これは彫刻家が荒い石を精巧な作品へと磨き上げるようなイメージです。以下は設定を変えて、むりに時間を短縮した生成物の結果です。デジタル技術が進化すれば処理時間は短縮できますが、現在は大きな課題です。

まとめ

記事で扱った論説「アナログ素材と3次元デジタル表現のコラボレーション」には、以下の記載がありました。

実験的に、人が生み出したアナログ素材(資産)を、現状のデジタル技術(AI)でどこまで継承できるか、また、デジタル技術ならではの表現が関心を得られるか模索する動画が、本作品だ。

筆者もいくつか、同様の実験を行ってきました[7]。ここまで記事では間接的に、生成AIの情熱に触れましたが現在、論説に記載された主旨と進化の方向性が相反してきました。もちろんアナログな資産を、よりよく継承していくものがデジタル技術です。そこに人類の大発明となる生成AIが加わって進化を続けると、事態は一変します。

「アナログな資産をデジタル技術が融合して、デジタルとデジタルがコラボレーションを行う」

今後はこんな新しい概念が一般化して、文化価値の有り方に一石を投じると、筆者は確信しています。そして何事であれどんな存在であれ、情熱と心意気を抱いて扱うことは未来永劫、不変な考えでしょう。

(参照論文)

[1] Common Sense Machines ,CSM 3D Viewer(Image to 3D), https://3d.csm.ai (参照2024/3/24).

[2] Dmitry Tochilkin, David Pankratz, Zexiang Liu, Zixuan Huang, Adam Letts, Yangguang Li, Ding Liang, Christian Laforte, Varun Jampani, "Yan-Pei Cao,TripoSR: Fast 3D Object Reconstruction from a Single Image", https://arxiv.org/abs/2403.02151, 4 Mar 2024.(参照2024/3/24)

[3] Mingyu Jin, Qinkai Yu, Dong shu, Haiyan Zhao, Wenyue Hua, Yanda Meng, Yongfeng Zhang, Mengnan Du, "The Impact of Reasoning Step Length on Large Language Models", https://doi.org/10.48550/arXiv.2401.04925 , 10 Jan 2024. (参照2024/3/25)

[4] Samuel R. Bowman, "Eight Things to Know about Large Language Models", https://arxiv.org/abs/2304.00612 , 2 Apr 2023. (参照2024/3/27)

[5] Cheng Li, Jindong Wang, Yixuan Zhang, Kaijie Zhu, Wenxin Hou, Jianxun Lian, Fang Luo, Qiang Yang, Xing Xie, "Large Language Models Understand and Can be Enhanced by Emotional Stimuli", https://arxiv.org/abs/2307.11760 , 14 Jul 2023. (参照2024/3/24)

*(AI-SCHOLAR 記事) https://ai-scholar.tech/articles/prompting-method/emotion-prompt

[6] Mingyu Jin, Qinkai Yu, Dong shu, Haiyan Zhao, Wenyue Hua, Yanda Meng, Yongfeng Zhang, Mengnan Du, "The Impact of Reasoning Step Length on Large Language Models", https://doi.org/10.48550/arXiv.2401.04925 , 10 Jan 2024. (参照2024/3/26)

[7] 米村貴裕,既存AI技術を用いた歌って踊る動画の試作と評価,芸術科学会 NICOGRAPH2022,S-7 p.1-4,2022.

*(AI-SCHOLAR 記事) https://ai-scholar.tech/articles/video-generation/arumenoy

この記事に関するカテゴリー