巨大言語モデルに潜む大きなリスク?!巨大言語モデルから情報が流出する脆弱性を示した重要な論文の紹介!

3つの要点

✔️ GPTシリーズのような汎化性能の高いモデルでさえ訓練データを記憶してしまい、それが情報流出につながる

✔️ GPT-2に実際に攻撃をしかけ、最大67%の精度で訓練データを抽出することに成功している

✔️ 大きなモデルほど訓練データを記憶する能力が高く、昨今のモデルを巨大化させる風潮に一石を投じた重要な論文となっている

Extracting Training Data from Large Language Models

written by Nicholas Carlini,Florian Tramer,Eric Wallace,Matthew Jagielski,Ariel Herbert-Voss,Katherine Lee,Adam Roberts,Tom Brown,Dawn Song,Ulfar Erlingsson,Alina Oprea,Colin Raffel

(Submitted on 14 Dec 2020)

Comments: Accepted to arXiv

Subjects: Cryptography and Security (cs.CR); Computation and Language (cs.CL); Machine Learning (cs.LG)

はじめに

昨今、OpenAIが開発したGPT-3(パラメータ数1750億)や、Googleが開発したSwitch Tansformer(パラメータ数1.6兆)のような巨大言語モデルがAI界隈を賑わせています。その理由の1つとして、巨大言語モデルが人間が作った文章と見分けの付かないほどの自然な文章を生成する能力を保有しているからです。GPT-2はあまりに自然な文章を生成するため、悪用される可能性が高いということから公開が中断されました。また、OpenAIは自然文を送信すると、それに対するGPT-3の生成結果が得られるAPIを公開しました。そのAPIを活用して、いくつもの驚くべきアプリが作成されました。以下はその1つの例ですが、Googleのデザインを自然文で記述してAPIに投げると、そのデザインを忠実に再現するhtml/CSSを生成しています。その他の応用例はこちらをご覧ください。

Here's a sentence describing what Google's home page should look and here's GPT-3 generating the code for it nearly perfectly. pic.twitter.com/m49hoKiEpR

— Sharif Shameem (@sharifshameem) July 15, 2020

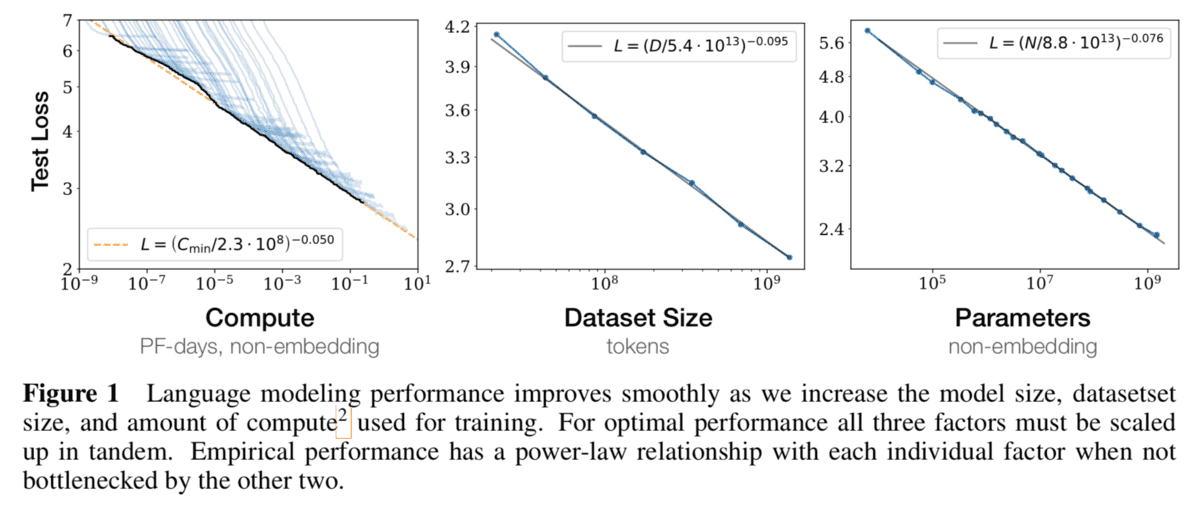

OpenAIはこのようなTransformerベースの巨大モデルに関して、scaling lawが成り立つという論文を発表しています。このscaling lawは、モデルサイズ・学習させるデータサイズ・学習を行う予算というたった3つの変数のみで、精度が決定してしまうというものです。例えば、以下の→図は学習させるデータサイズと予算を固定したときに、モデルサイズを増加させていくと、モデルの精度は対数グラフ上で直線的に増加していくことを示しています。しかも驚くべきことに、このscaling lawには現在のところ制限がありません。つまり、モデルサイズを大きくすればするほど、モデルの精度はこの直線に従って上限なく伸びていくということです。これは、AIモデルの精度はとにかくどれだけ大きなモデルを扱えるかという単純な問題に帰結することを示唆しています。

上記のような背景から、巨大モデルは様々な分野で大変注目を集めています。しかしここで、1つの懸念事項が生まれます。巨大モデルは大量のデータで学習されており、そのデータの中に個人情報や外部に出してはいけない情報が含まれていた場合、巨大モデルはそういった情報をそのまま記憶してしまい、その結果、情報のリークが生まれてしまうのではないかと。

訓練データをそのまま記憶してしまっているというのは、モデルが過適合しているということです。つまり、汎化性能が低いモデルになっていることを示しています。巨大モデルは精度が非常に高く、汎化性能が高いため、従来の研究ではこのような記憶の可能性は低いとされていました。しかし、今回紹介する論文では、巨大モデルにおいても同様に訓練データの記憶が行われ、モデルサイズが大きくなるほど、訓練データの記憶がより多く行われることを示しています。これは、巨大モデルであればあるほど、個人情報などが抜き取られる可能性が高くなるということです。この論文はGPT-2に攻撃を仕掛けることで、訓練データの一部を抽出することに成功しています。昨今の巨大モデルには大きなリスクが潜んでいることを示した、非常に重要な論文であると言えます。

続きを読むには

(7299文字画像11枚)AI-SCHOLARに

登録いただく必要があります。

この記事に関するカテゴリー