比较模型的性能需要多少学习?

三个要点

✔️提出一种在训练过程中预测模型最终性能的方法

✔️利用部分学习曲线对模型的最终性能进行比较和排序。

✔️将您的NAS加速至100倍。

Learning to Rank Learning Curves

written by Martin Wistuba, Tejaswini Pedapati

(Submitted on 5 Jun 2020)

Comments: Accepted at ICML 2020

Subjects: Machine Learning (cs.LG); Computer Vision and Pattern Recognition (cs.CV); Machine Learning (stat.ML)

介绍

在NAS(网络架构探索)和HPO(超参数优化)中,许多不同的机器学习模型被训练成发现最佳结构和超参数。这些AutoMLs的主要挑战是,在搜索过程中实际训练模型时,会有很大的计算成本,比如模型结构。因此,建立一种快速评估好坏架构的方法是包括NAS在内的AutoML的重要研究课题。

在本文介绍的论文中,提出了一种提前中断低性能架构的学习以降低学习成本的方法。实验证明,在性能损失最小的情况下,可以使NAS速度提高100倍。

预备

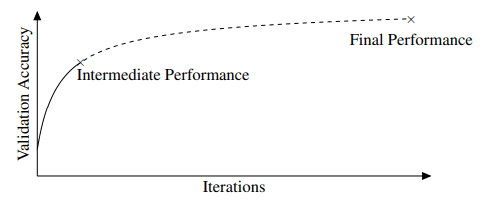

学习曲线的外推法是现有的一种在训练初期预测模型最终性能的方法。如下图所示,这种方法从学习曲线得到一半的时候(图中的中间性能点)预测模型的最终性能。

这样的外推方法涉及到大量的计算成本,因为实际上要对大量的训练曲线进行采样。本文提出的方法LCRankNet,并不能以此预测模型的最终性能。

首先,在NAS架构搜索过程中,最重要的是一种模式与另一种模式的相对性能比较。该模型的性能如何,没有绝对的性能要求。因此,LCRankNet可以预测模型的最终性能,直接预测哪个模型比其他模型好,而不是根据模型的大小来比较模型的优劣。

术语

前面讨论了该方法描述中的重要方面的符号。

在下面的描述中,我们将整个学习曲线(训练完成到最后得到的)表示为$y_1,...,y_L$,在这种情况下,$y_i$代表模型的性能(例如分类精度)。 在这种情况下,$y_i$代表了模型的性能(例如分类精度),并以固定的时间间隔(例如每几个纪元)确定。

部分学习曲线(在训练中间得到)也表示为$y_1,...,y_l$。

要阅读更多。

你需要在AI-SCHOLAR注册。

或与本文相关的类别