2021年公開記事のトップPV記事

2021年はTransformerを中心に物凄く発展していきました.まだまだ,性能がこんな感じに上がる!これらの理論からそもそもプーリングだけでいい?とまだまだ理論的にも理解が進んでいる段階であることは間違いない年でした.

Transformerや教師なし学習,NeRFと今なお進歩の中にいるAIにおいて,2021年に読まれた記事トップ5を紹介します(2021年に公開されたものでフィルタしています).ちなみに2021年公開ではない記事が2021年に最も読まれています.Data Augmentationのまとめの記事ですが,それほど多くの方が勉学にも励んだ年でも言えると思います.

No.1:グラフってこんなにすごい!深層学習との融合をレビュー

深層学習とGNNの理論を融合させるための,Survey論文が今年最も読まれた記事となりました.GNNの基本から発展まで網羅的に書かれたこの論文はとても分量もある中で余すことなく,なるべく重要ポイントをピックアップして書かれたこの記事が堂々の第一位でした.今までの傾向ではsurvey論文は読まれにくいというものがありましたが,異例のPV数を獲得しています.

No.2:量子機械学習で何が起こっているのか?

さらなるAIの爆発的な発展に起因するとして,量子コンピュータに期待する人も多かった結果なのか.第二位は量子機械学習の実情をまとめた論文の紹介記事でした.2022年に期待していきたいですね.

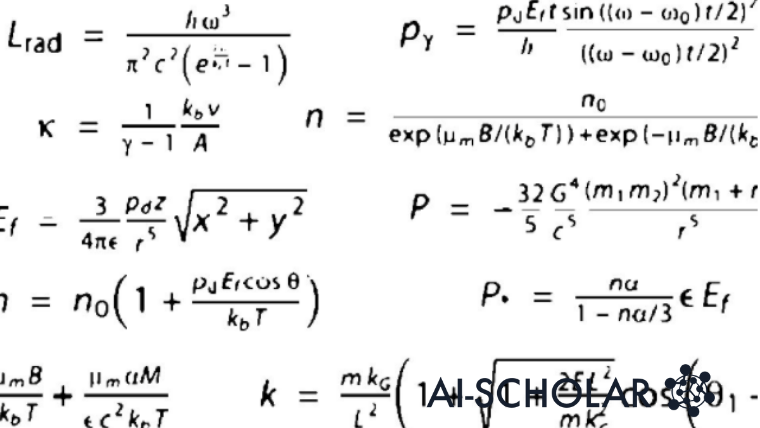

No.3:ファインマン物理学方程式を機械学習で発見する:AI Feynman

ミステリーデータの対称性や分離可能性などの隠れた単純さを発見し、難しい問題をより少ない変数でより単純な問題に再帰的に分割するといった成果を上げたこちらの論文は,AIが方程式を発見するというロマンのような論文でした.

No.4:【GAN】NVIDIAが極端に少ないデータセットでも高精度なGANを達成! 過学習しないAugmentation ADAとは!?

NVIDIAが発表したこちらの論文は,少ないデータでGANを学習させるテクニックになります.NVIDIAは物凄くGANの技術に発展または起因している企業だと思われます.今後もGANの発展にはNVIDIAの研究者たちが活躍する気がします.

No.5:【バッチ正規化を使用しない新たなチャンピオンNFNetsが登場!画像タスクトップの性能!

バッチ正規化は,ほとんどのタスクで当たり前のように使用されています。バッチ正規化は損失面を平滑化し、ネットワークに正則化効果を与え、より大きなバッチで学習できるようにすることが示されています。こういった当たり前に疑念を持って研究することは今後のAIの発展にも重要になってくると思います.それこそTransformerを画像に使うという固定概念的にはあり得ないことをした結果の2021年を忘れずに,もっといろんな可能性を追求していきたいですね.

まとめ

やはり,まだまだAIは発展途上の技術と言えます.いまだに理解が追いつかない現象もありますし,今までの定説が覆されることも多い一年でした.そして,教師なし学習の精度の向上や,未知データへの効果的な対応方法など,社会実装にはもちろん遠い領域もあるものの器用に活用し成果を出している企業も存在しています.

これからの発展にさらに期待をし,来年2022年を迎えましょう!皆さん,1年お疲れ様でした.

この記事に関するカテゴリー