用于时间序列预测的TSDFNet,具有周到的特征值融合机制。

三个要点

✔️ 在时间序列预测中,需要花费大量精力通过领域知识设置感兴趣的特征,以提高准确性。

✔️ TSDFNet使用自溶机制和贴心的特征融合机制来提取重要的特征,不需要任何特征工程。

✔️ 在十几个数据集上进行了验证,证实了预测性能明显优于传统方法,如Seq2Seq和LSTM-SAE。

Temporal Spatial Decomposition and Fusion Network for Time Series Forecasting

written by Liwang Zhou, Jing Gao

(Submitted on 6 Oct 2022)

Comments: Published on arxiv.

Subjects: Machine Learning (cs.LG); Artificial Intelligence (cs.AI)

code:

本文所使用的图片要么来自论文、介绍性幻灯片,要么是参考这些图片制作的。

摘要

为了在时间序列预测中取得更好的结果,需要进行特征工程,而分解是其中重要的一项。然而,标准的时间序列分解缺乏灵活性和稳健性,一种分解方法往往不能用于许多预测任务。传统的特征选择在很大程度上依赖于现有的领域知识,缺乏通用的方法,并且需要大量的努力。然而,许多基于深度学习的时间序列预测模型普遍存在可解释性问题,"黑箱 "结果不能激发人们的信心。解决上述问题是本文的动机。本文提出TSDFNet是一个具有自动回归机制和周到的特征融合机制的神经网络。它放弃了将特征工程作为预处理的惯例,创造性地将其作为内部模块与深度学习模型相结合。自动回归机制使TSDFNet对任何时间序列具有可扩展和自适应的分解能力,允许用户选择自己的基础函数,并将其分解为时间序列和通用空间维度。贴心的特征融合机制有能力捕捉到外部变量的重要性以及它们与目标变量的因果关系。它还可以自动抑制不重要的特征,强化有效的特征,这样用户就不必在特征选择上费劲了。此外,TSDFNet使得通过特征可视化查看深度神经网络的 "黑匣子 "和分析预测结果变得容易。十多个数据集显示了比现有的被广泛接受的模型更高的性能,三个实验显示了TSDFNet的可解释性。

介绍。

时间序列预测在许多部门发挥着重要作用,如经济、金融、运输和天气,使人们有能力预见机会并指导决策。因此,提高时间序列模型的通用性,降低建模的复杂性,同时保持性能是很重要的。在时间序列预测领域,多变量和多阶段预测构成了最具挑战性的任务之一。目前,还没有处理多变量和多阶段时间序列预测问题的通用方法。因此,数据分析员需要有专门的背景知识(领域知识)。

特征工程通常被用来在建模前对数据进行预处理。 在特征工程领域,时间序列分解是将复杂的时间序列分解为若干可预测的子序列的经典方法,如STL用于季节和趋势分解,EEMD用于集合经验模式分解,EWT用于经验小波变换。另一个重要步骤是特征选择。复杂的任务通常需要几个辅助变量来帮助预测目标变量。合理选择附加特征对模型的性能至关重要,因为引入多余的附加特征可能会降低模型的性能。

这是因为引入冗余的额外特征会降低模型的性能。此外,如何选择合适的分解方法和重要的附加功能是数据分析师的一个难题。

另一方面,尽管提出了大量的模型,但每个模型都有自己的缺点。大多数基于深度学习的模型都难以理解,并提供令人信服的预测结果。然而,像ARIMA和xgboost这样具有良好数学基础并提供可解释性的模型,在性能上无法与基于深度学习的模型竞争。

因此,有必要打破传统做法,设计新的方法来处理这些问题。在这项研究中,基于自溶机制和贴心的特征融合机制,开发了一个名为TSDFNet的新神经网络模型。分解和特征选择被整合为深度模型的内部模块,降低了复杂性,提高了适应性。数据的高阶统计特征可由模型的稳健特征表示能力捕获,使其适用于各种领域的数据集。

归纳起来,其贡献如下。

- 时间分解网络(TDN)将时间序列随时间分解,是可扩展的自适应网络,允许用户为特定任务定制基础函数。

- 空间分解网络(SDN)使用高维外部特征作为分解基础函数来模拟外部变量和目标变量之间的关系。

- 还提出了一个关注性特征融合网络(AFFN),它具有自动选择特征的功能,并能捕捉到特征的重要性和因果关系。这为用户省去了选择特征的麻烦,并允许在自回归网络中使用任何基函数,而不必担心由于引入无效的特征而导致模型性能下降的问题。

- TSDFNet对多层面的数据集产生了可解释的结果,与以前的许多模型相比,其性能有了明显的提高。

相关研究

时间序列预测领域有很长的历史,已经开发了许多好的模型。最著名的传统方法包括ARIMA和指数平滑法,其中ARIMA模型通过差分将非平稳过程变成平稳过程,并可进一步扩展为VAR,以解决多变量时间序列预测问题,主要是由于其可解释性和易用性。另一种有效的预测技术是指数平滑法。这通过给予数据随时间变化的指数递减权重来平滑单变量时间序列。

由于时间序列预测本质上是一个回归问题,也可以使用各种回归模型。还有一些基于机器学习的方法,如决策树和支持向量回归(SVR)。

此外,采用多种学习算法以达到比仅用一种组成的学习算法所能达到的更好的预测性能的集合方法也是序列预测的有效工具。这种方法的例子包括随机森林和自适应提升算法(Adaboost )。

近年来,深度学习已经变得很流行,神经网络在许多领域都取得了成功。这使用反向传播算法来优化网络参数。LSTM(长短时记忆)及其衍生物在连续数据方面显示出巨大的力量,而RNNs(循环神经网络)则显示出巨大的力量。深度自回归网络(DeepAR)使用堆叠的LSTM来进行迭代的多阶段预测,而深度状态空间模型(DSSM)采取类似的方法,使用预定义的一个类似的方法是使用LSTM为预定的线性状态空间模型生成参数;Seq2Seq(Sequence to Sequence)通常使用一对LSTM或GRU作为编码器和解码器。编码器将输入数据映射为隐藏空间中的固定长度的语义向量,而解码器则读取上下文向量,并试图一步步预测目标变量。时间卷积网络(TCN)也可以有效地应用于序列预测问题,并可作为常见的RNN系列方法的替代品,与基于RNN的模型相比,速度更快,参数更少。

与使用因果卷积和剩余连接的基于RNN的模型相比,它的速度更快,参数更少。注意机制作为一种基于编码器-解码器的改进出现,可以很容易地扩展到自我注意机制,作为进一步Transfomer模型的核心。

技术

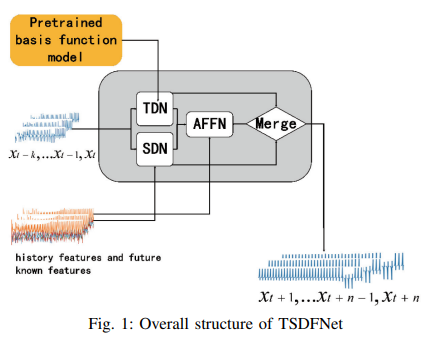

该网络的结构如图1所示。它由两个主要部分组成:第一部分是包含TDN和SDN的自回归网络。特征融合网络(AFFN)是一个额外的组件。

A. 自溶网络

自回归网络的结构包括两个分解模块:一个是时间分解网络TDN,它采用了自定义的基础函数来分解时间维度上的序列。另一个是空间分解网络SDN,它使用外生特征作为基础函数,在一般化的空间维度上对序列进行分解。主要目的是将复杂的序列分解成简单和可预测的序列。

TDN可以使用预先训练好的不同参数的多个基函数来捕捉信号特征,如三角形、多项式和小波基。

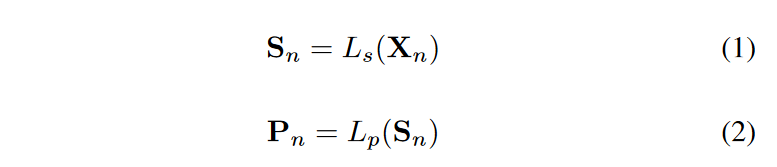

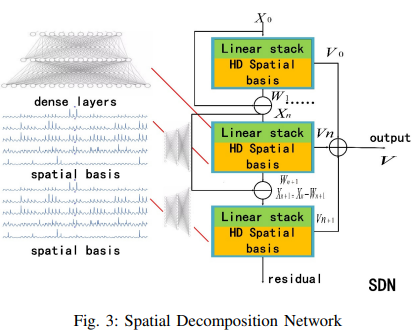

TDN的结构如图2所示:TDN中有N个递归分解单元。第(n+1)个单元接受每个输入Xn作为输入,并输出两个中间成分Wn和Vn。每个分解单元由两部分组成:一个堆叠的全连接网络Ls将数据映射到隐藏空间并生成语义向量Sn,并分别通过两组全连接网络Lp和Lq向前和向后预测基础扩展系数。该过程如下。

该程序如下。

另一个是一组预先训练好的基础函数模型。这是一个时间矢量t = [-w, -w + 1, ..0, h -1, h]/L函数。其中L=w+h+1,w是驱动序列的时间历史窗口长度,h是目标序列的时间窗口长度。这个时间向量被送入不同的预训练模型,Cn = [sin(-kt), cos(-kt), ...,cos(kt),sin(kt)],不同频率的三角函数,定义为Cn=[t,t2,t3。.tk],不同度数的多项式函数,定义为Cn=[-w/L。.0]和Cpn,当t=[0。.h/L]和Cpn当t=[-w/L...0]时,分别用于拟合过去和未来的数据。它们的系数矩阵Pn和Qn决定了每个基础函数的重要性。

- 第n个区块的最终输出定义如下。

- 对下一个区块的输入定义如下。

- 原始信号X0=[xt-w, xt-w+1..., xt-1]继续去除落后的特征分量Wn,理想情况下,残留的是随机噪声,不再有特征信息。

- 每个分解单元的前向输出被整合如下,产生一个TDN输出。

- 模型的超参数N被定义为分解层的数量,取决于所选择的基础函数的类型,并且对每个基础函数都是可重复的。这些基函数网络的权重可以针对不同的任务再调整一次,以适应不同的场景。

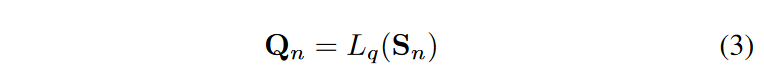

- 图3显示了空间分解网络(SDN)。其结构与TDN相似。不同的是,SDN采用了映射到更高维度的外部特征作为基向量Cpn和Cqn。详情如下。

- 其中Ep是过去的附加特征,Eq是未来的附加特征,Ln是一个堆叠的全连接模块,它将过去和未来的附加特征分别映射到更高的维度。它采用嵌入的方式来转换一些离散的特征,并采用0来填补缺失的特征。此外,需要注意的是,自回归模块提供了处理单变量时间序列的灵活性。空间分解网络(SDN)模块可以被禁用,也可以启用SDN以接受来自其他方法(如EMD)的特征成分作为输入。

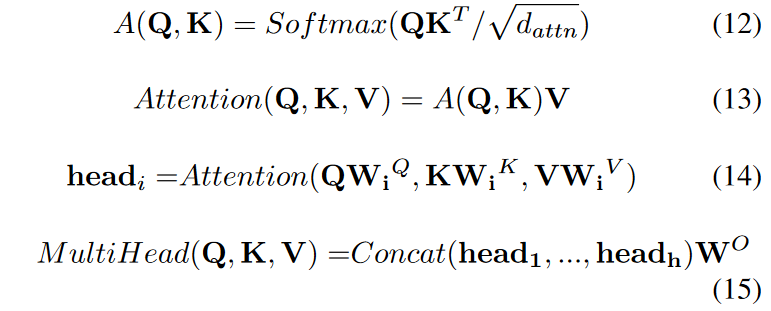

B. 殷勤的特征融合网络

如图4所示,特征选择模块被设计为进行逐个实例的变量选择,决策单元组反复抑制不相关的特征,多头关注块接受特征选择模块的结果作为输入,并进一步建立全局关系模型。系统的输出被用来模拟特征与特征之间的全局关系。最后,GLU和FC在每个时间步长获得输出,其中GLU试图抑制输入数据的无效部分。

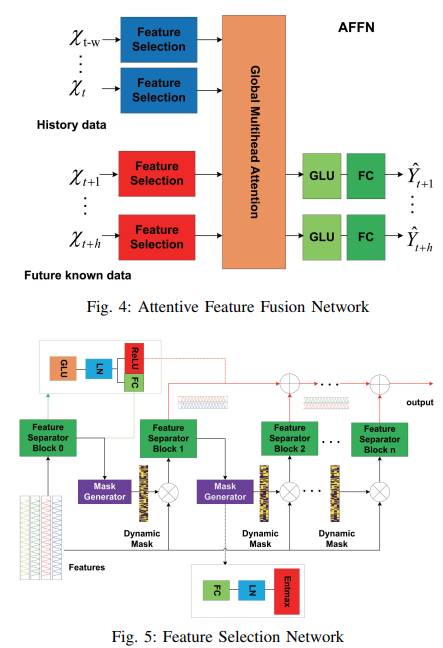

如图5所示,设计了一个包括掩码发生器和特征分离器的特征选择块。

一个可学习的掩码生成器被用来生成一个动态掩码M,其可解释性表明了每个维度特征的重要性。决策步骤j的掩码将步骤j-1分离的特征作为输入。Mj = entmax(h(aj-1),其中h是一个可学习的函数,entmax具有将矢量映射为稀疏概率的能力,类似于传统的softmax。一系列的基函数特征可以通过M进行过滤,其中Mj=0表示这一步的特征输入与预测任务无关,因为这个样本,过滤后的特征M-X被送入下一个决策步骤。一般来说,我们对哪些特征对目标变量贡献更大感兴趣。如果数据集的批量大小为B,时间长度为T,决策步骤为J,则重要性分布为

特征分离器有一个共享层,由GLU、LN组成;层正常化(LN)是一种将中间层的分布正常化的技术。特征分离器的共享层s的输出被分为两部分[s1, s2],其中一部分f1(s1)作为掩码生成器的输入,另一部分f2(s2)作为第j层决策的输出,其中f1是FC层,f2是Relu,如果s2<0,则对当前决策输出有帮助如果s2<0,它对当前的决策输出没有贡献。

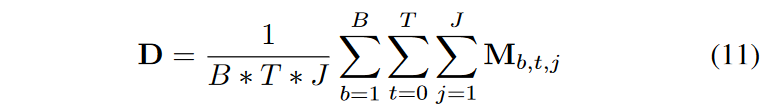

众所周知,多重关注的内容如下。

其中,MultiHead(Q, K, V)代表注意力函数;Softmax是概率分布函数,参数dattn是将特征按比例归一;K是一个时间段的关键;V是特征值;Q是输入的查询特征;WO 是网络输出的权重是。该模型使用一个自我注意机制来学习每个特征在不同时间的相关性。对于一个给定的目标元素查询,通过计算查询Q和K之间的相似度,得到目标的每个键的权重系数,然后用目标的加权和来得到最终的关注值。通过将模型分成几个头,形成不同的子空间,就有可能将重点放在特征的不同方面。在这个模型中,Q是特征选择模块输出的所有历史信息的高维特征,而K和V是未来已知信息的高维特征。

实验

为了评估所提出的TSDFNet,我们选择了一些典型的模型,如基于因果卷积的TCN、基于CNN和RNN的Lstnet、基于注意力和LSTM的Seq2Seq以及基于堆叠自动编码器的Lstm-SAE,并进行了彻底的评估。比较。

A. 实施。

该实验在Ubuntu系统上使用Pytorch框架。硬件配置是Intel(R) Core(TM) I7-6800K CPU @ 3.40 GHZ, 64 GB内存和GeForce GTX 1080 GPU。

首先,构建几个具有不同参数k的合成基函数,使模型yi = Ci(kt)具有多样性,包括三角函数和多项式函数。这些模型是用L2损失训练的三层全连接网络。每个数据集有10000个训练样本,训练周期设置为100,实验中的批次大小设置为40。

第二阶段是使用ADAM优化器训练TSDFNet,初始学习率为0.0001。辍学率被设置为0.1,以获得更好的概括性,批次大小被设置为32。为了避免过度拟合,采用了早期停止,如果在10个 epochs内没有损失退化,则终止学习过程。评价指标是RAE和SMAPE。

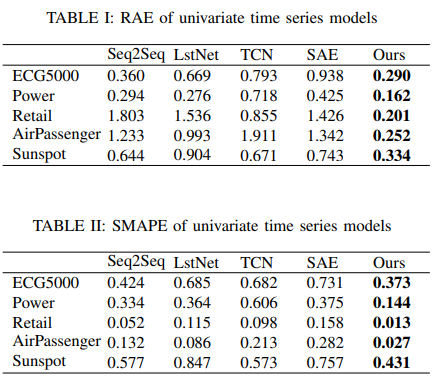

B. 单变量时间序列预测和结果分析

表一和表二列出了五组代表性数据的单变量分析结果 。 由于心电图和能源消耗是准周期性的,因此很难预测不确定性的高峰和低谷。由于训练样本较小,零售销售和航空乘客人数数据很难可靠地预测周期和趋势。另一方面,太阳黑子的爆发是周期性的,但由于其极长的时间尺度而无法预测。

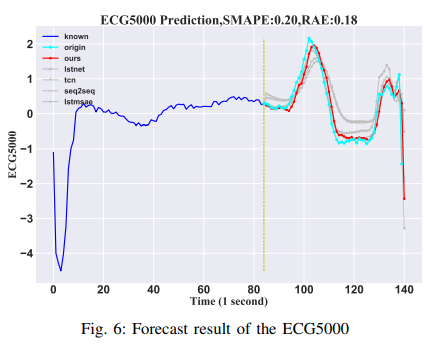

ECG5000。

共有5000张心电图(ECG),4500个样本用于训练,500个样本用于测试,来自UCR时间序列数据的数据集。序列中的每个样本是140个时间点。在这个实验中,前84个时间步骤被用作输入,最后56个时间步骤被预测为结果。结果显示在图6中。

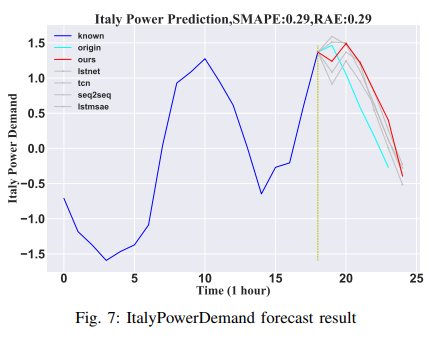

意大利的电力需求。

该数据集来自意大利12个月的电力需求时间序列;1029个样本被训练,之后对67个样本进行了评估。每组共有24个样本。在这个实验中,前18个小时的数据被用来作为预测后续6个小时数据的输入。结果显示在图7中。

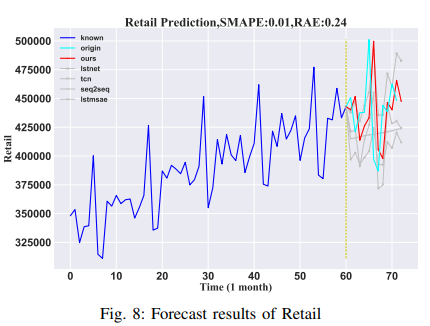

零售业

Kaggle数据集提供了美国1992年1月1日至2016年5月1日的月度零售销售数据。总共有293个样本。在本文中,95%的数据被用作训练集,5%被用作测试集。前12个月的数据被用来作为预测未来6个月数据的输入。结果显示在图8中。

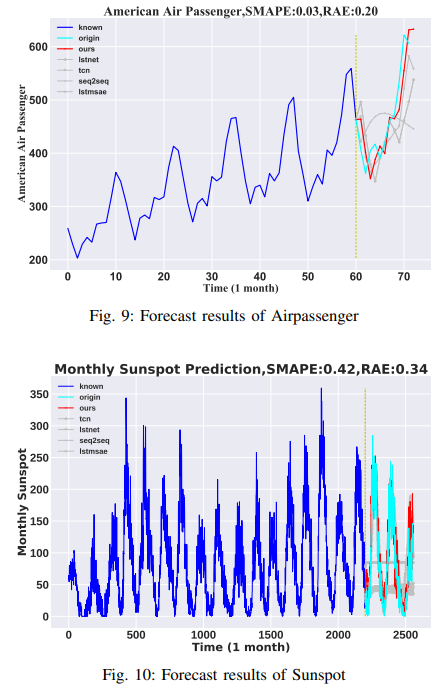

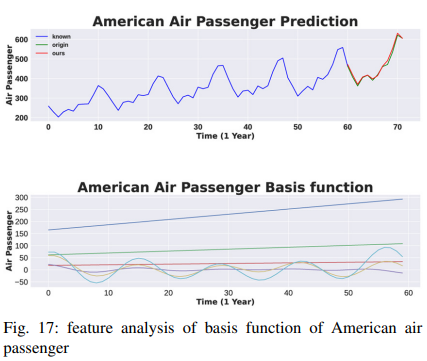

空中乘客

这个数据集提供了1949年至1960年美国航空公司的外国航空公司的每月乘客数字。总样本量为144。训练集包括1949年至1959年的数据,测试集包括1960年的数据。输入的数据跨越60个月,有12个月的预测。结果显示在图9中。

太阳黑子

该数据集由每月的太阳黑子观测数据组成(1749-2019),共有2820个样本;95%被用作训练集,最后5%被用作测试集。输入数据的长度是2200个月,它预测了360个月的未来数据。结果显示在图10中。

C. 多变量时间序列。

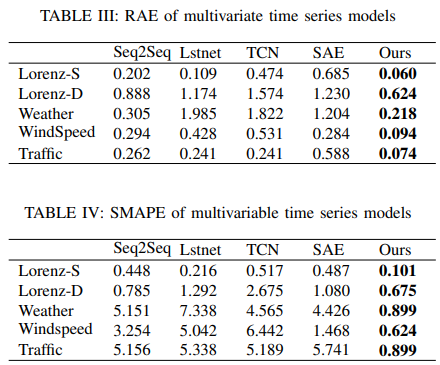

表三和表四列出了对五组代表性数据的多元分析结果。气象数据集、交通数据集、来自实际观测的风速数据集和两个人工洛伦兹数据集是多变量数据集的例子。这些多变量数据集往往是典型的混沌系统,比单变量数据集更复杂,因此有必要为其添加特征以帮助预测。为了更有效地证明这个问题,Lorenz flalign(全长对准)创建了一个Lorenz数据集,相关参数可以进行统计调整。温度,天气数据集的目标变量,有多种模式周期,并受到一些额外因素的影响,使其成为展示模型可解释性的良好选择。由于交通和风速数据集的不确定性非常高,有必要采用已知的未来因素,如风速和其他站点的平均车速来帮助预测。其他模型也包括已知的未来元素,但结果很差,表明本研究中的模型对空间信息的特点有很好的理解。

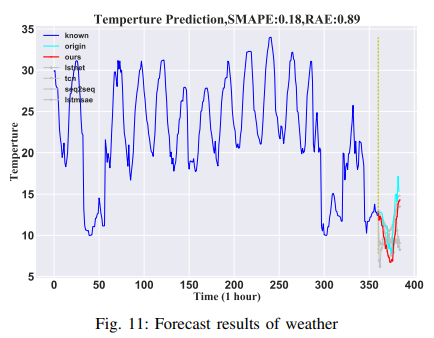

天气预报

跨越2006-2016年的数据集从Kaggle获得。本实验的温度预测取决于其他变量,如湿度、风速、风向、能见度、云量和气压。数据中共有96453个按时间划分的样本。95%的数据用于训练,5%用于测试。该模型使用前2200小时的数据来预测未来360小时的温度,并带有外部特征。结果显示在图11中。

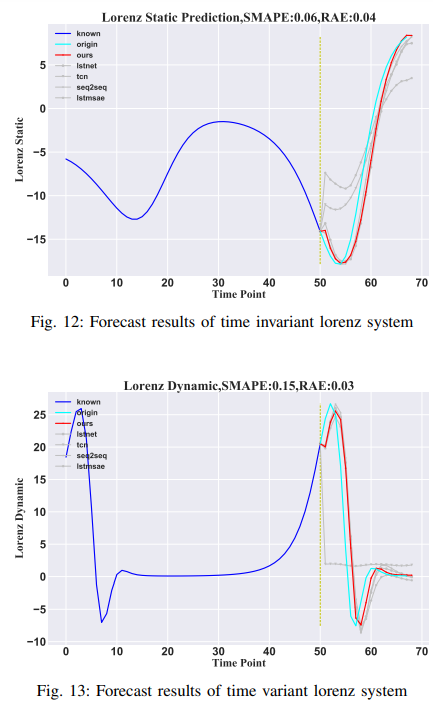

洛伦兹。

其中G(-)是X(t)=(xt1, ...)的洛伦兹非线性函数集。, xt90)′的洛伦兹非线性函数集,P是参数向量。本文对时变和时变洛伦兹系统进行了测试,以显示时变和时变系统所描述的模型之间的区别,分别。在时间不变的洛伦兹系统(Lorenz-S)中,P不随时间变化,而在时间变化的系统(Lorenz-D)中,P则随时间变化。在实验模拟中,产生了5000个样本,前90%的数据作为训练集,最后10%作为测试集。实验结果表明,本文提出的模型对时变和时不变的系统都有良好的效果。结果显示在图12和图13。

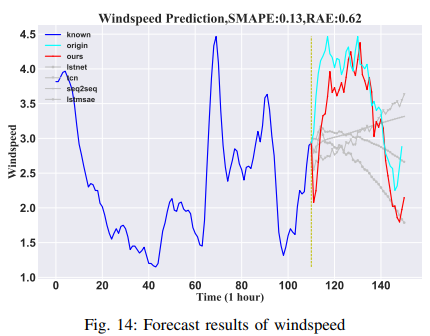

风速

该数据集是由日本气象厅提供的稚内155个站点的高维(155维)风速数据,每10分钟记录一次,共计138,600分钟。在本文中,已知的110分钟的持续时间被用来估计随后40分钟的风速。其他154个站点的数据被用作额外的特征,155个站点之一的目标风速被随机选择。预测风速被认为是非常困难的,但这种方法在预测风速方面给出了非常好的结果。预测风速被认为是非常困难的,但这种方法的预测结果比其他方法更好。结果显示在图14中。

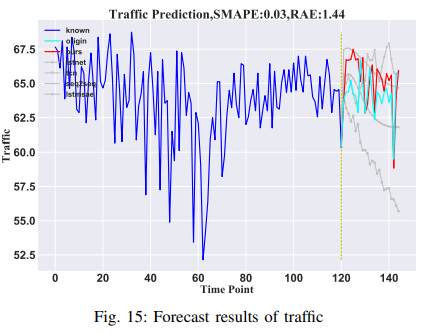

交通量

平均车速(MPH)是利用洛杉矶134号公路沿线207个环形检测器的数据进行预测的,每个检测器的观测值被视为一个单独的变量。前120小时用于预测24小时内的平均速度。从高维数据中,选择一个传感器的数据作为目标变量,而其他传感器的观测数据则作为辅助特征。这证明了该模型预测空间数据的能力。结果显示在图15中。

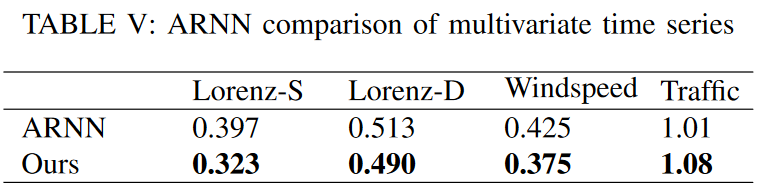

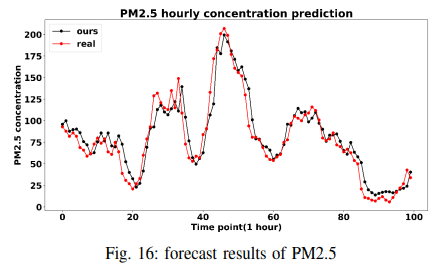

为了更好地进行比较,我们没有复制论文,而是沿用了ARNN(自动储备库神经网络)的实验结果,在洛伦兹、风速和交通数据集上进行测试,以RMSE作为指标。为了说明TSDFNet在单步预测问题上表现良好,我们将其与LSTM-SAE在空气质量数据集上进行了比较,结果见表五。预测涵盖了2010年至2014年的PM2.5浓度,模型实现了RMSE的大幅降低(从24降至15)。结果显示在图16中。

D. 讨论。

在确立了TSDFNet的性能优势后,我们表明,这种模型设计使我们能够分析其具体的组成部分,并解释模型所学习的一般关系。首先,通过分析公式(4)所描述的TDN的可解释性变体,对特征的重要性进行量化。航空旅客数据集不是静止的,包含了季节性和趋势的混合物。这种情况每年都在增加,而且每个月都在频繁变化。结果如图17所示,图中最上面一行显示的是原始信号及其预测,第二行显示的是基函数。

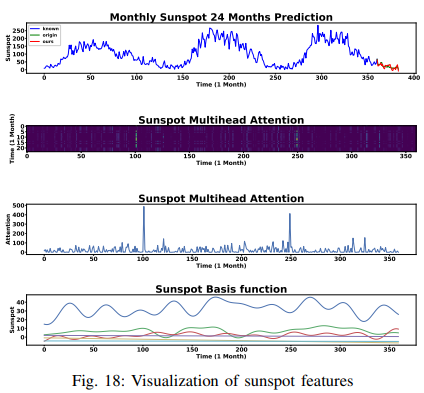

太阳黑子数据集的结果显示在图18中。图中最上面一行显示了季节性的存在,而最下面一行显示了微调三角基函数对周期性的把握程度。此外,注意权重模式,即TSDFNet根据推断突出决定性的时刻,也可能是相当有信息量的:在第二行,可以看到许多明亮的条纹在黑暗的背景下间隔开来。这些代表了一个新周期的开始;汇总每个时间步骤的选择权重,如第3行所示,我们可以看到,感兴趣的峰值与太阳黑子的低谷相吻合。

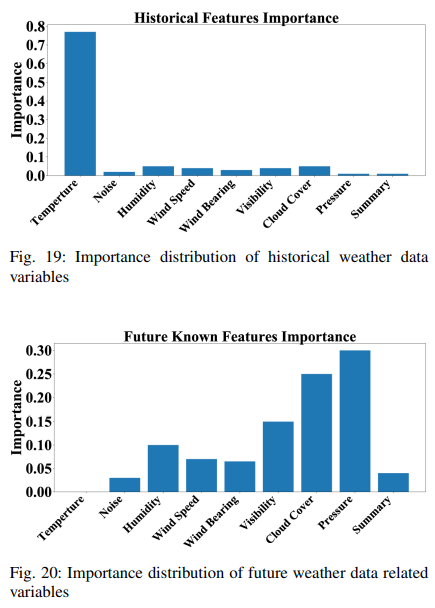

此外,由(11)确定的每个特征的重要性,可以使用特征选择块的决策权重模式来检查。历史特征的重要性分布如图19所示,同时也考虑了历史数据的其他特征成分。可以看出,历史温度数据约占未来温度数据的75%的重要性。图20中描述了未来已知数据的重要性分布。可以看出,预测的准确性在很大程度上取决于未来的压力和云层厚度。未来的温度数据无法得知,并被填上0的数值,所以它对结果的贡献是零。我们还使用高斯噪声作为输入,以显示我们的模型如何消除不重要的变量。高斯噪声的贡献是最小的,因为它没有相关信息。

摘要

本文介绍了时空分解融合网络(TSDFNet),这是一个新颖的可解释的深度学习模型,将特征工程纳入建模,并取得了惊人的性能。利用特殊组件来处理时间序列的长期预测问题:时间分解网络(TDN)可以定制任何基础函数作为时间序列分解的特征模式;空间分解网络(SDN)使用外部特征作为序列分解的基础函数,而Adentive特征融合网络(AFFN)则融合所有输入特征并选择最重要的特征。最后,大量的实验表明,与各种著名的算法相比,TSDFNet始终能够产生最先进的性能。

与本文相关的类别